大數據預測行銷:翻轉品牌X會員經營X精準行銷

2019/07/09

I. 大數據X大真相

- 大數據是一門跨領域的知識,涵蓋了資訊科學、統計演算以及商業實務。

- 大數據軟體:KNIME,Weka,Power BI,Tableau,SPSS,SAS,Statistica,Excel...。

- 在大數據投資的目的上,B2B的企業如製造業,著重在應用大數據分析改善流程、降低生產成本;

B2C的企業如零售業,著重在應用大數據預測行銷,增加銷售,提升利潤。

II. 大數據X大平台品牌策略

- 大數據時代顛覆企業經營

- 經營內容品牌

PRRO取代

AIDA。

過去,經營實體品牌,有個由美國廣告先驅Elias St.Elmo Lewis最早所提出、也是最經典的,

幾乎是所有行銷人都能朗朗上口的行銷觀念:

A-I-D-A,

即要達成行銷目標,首先要建立

品牌知名度(Awareness),沒有知名度一切免談;

其次要引起消費者

對品牌產生興趣(Interest)及對產品

產生購買渴望(Desire);

完成以上三項任務,就有可能

讓消費採取購買行動(Action)。

- 大數據時代大眾媒體不再那麼有效,卻給了我們一個新的機會,應用分散式信任的機制來建立品牌。

即以

PRRO來取代傳統的AIDA,成為經營品牌的新法則。

PRRO就是

Platform(平台),

Review(評價),

Reliance(信賴),

Order(購買)。

Platform:首先,你必須找出最多人用、最有影響力的幾個平台品牌,然後依附在上面。

Review:接著,認真經營品牌在這些平台上的評價。

Reliance:鎖定平台後,再透過各種服務及行銷方法,提升顧客的評價。

Order:當信賴度越高的時候,就會為品牌帶來大量的訂單。

- 定位大師AI Ries:「如果網路是一門生意,但是你同時把品牌名放在實體店及網路,

將是一個嚴重的錯誤。」

III. 大數據X大平台行銷策略

- 人機介面研究教授Larry Constantine提出,好的UI需要滿足六個原則:即

結構原則、

簡單原則、

視覺原則、

回饋原則、

容錯原則及

再用原則。

作者再補充兩個品牌行銷的觀點,就是UI的設計也要考慮

美觀原則及

定位原則。

--

結構原則:就是UI的結構要清晰,同類、同層次的東西要放在一起,是平台或APP的生命。

- 好的UI決定了完美的UX(消費體驗)、完美的UX決定了消費者的黏著度,

也就決定了交易的轉換率(Conversion Rate),決定了平台的成敗。

- 平台品牌的行銷策略:供給面策略、需求面策略。

- 平台的供給面行銷策略:

1.影響者策略(Influencer Strategy)

2.MGM策略(Member-Get-Member Strategy)

3.事件策略(Event Strategy)

4.獎勵策略(Incentive Strategy)

5.附加價值策略(Value-Added Strategy)

6.意見領袖策略(Opinion Leader Strategy)

7.延伸策略(Extension Strategy)

- 平台需求面策略:

1.影響者策略(Influencer Strategy)

2.MGM策略(Member-Get-Member Strategy)

3.事件策略(Event Strategy)

4.回饋策略(Reward Strategy)

5.異業合作策略(Co-op Strategy)

6.蠶食鯨吞策略(Encroachment Strategy)

7.免費試用策略(Free Trial Strategy)

IV. 大數據X預測行銷

- 商業分析6步驟:TASSS$

(Task-Analysis-StrategicViewpoint-Strategic Option-Schedule-Budget)

Step1.

Task 課題:

報告中所有的分析跟結論,都要圍繞著「課題」。

如果能塑造吸睛的題目,就能提高讀者的興趣,用問句破題也是一個被證明有效的方法。

例如「銀行分行坪效分析」、「國際品牌策略」,

就不比「如何提高銀行分行的坪效?」、「如何打造一個國際品牌?」有吸引力。

Step2.

Analysis 分析:

資料到處都有,但要寫出一份聚焦的報告,分析的範圍,

就要僅限跟課題有關的資料。要用哪些工具做分析呢?作者偏好使用

STEP、

競-消-我、以及

SWOT三種分析。

-

-STEP分析對象是環境面。指的是從

社會(Society)、

科技(Technology)、

經濟(Economy)與

政治(Politics)四個角度來分析。

--「

競-消-我」分析就是「競爭者-消費者-自我」分析,對象是產業面。

要思考「誰跟我競爭?」、「消費者怎麼看?」、「我們有什麼優勢?」

這三個問題,正好構成一個金三角。

--

SWOT分析,對象是企業面,SWOT分別代表

Strength優勢、

Weakness弱點、

Opportunity機會、

Threat威脅。

Step3.Strategic Viewpoint 策略性觀點

Step4.Strategic Option 策略性方案

Step5.Schedule 執行時間表

Step6.Budget 預算

- 做分析要多琢磨策略性觀點與策略性方案。大數據決策,指的正是看了數據之後產生觀點;

或有了觀點之後,再找數據佐證。

- 觀點能驅動數據,即Insight drives big data,沒有觀點,大數據分析就沒有意義了。

- 預測分析6步驟TAMEDI:建立精準模型

Step1.

Task 課題:

與商業分析最大的不同是,預測分析的課題,是解決「一個個人」的問題。

例如:「如何提高每一個顧客的貢獻率?」、「如何喚醒每一個沉睡中的客人?」

Step2.

Analysis 分析

Step3.

Modeling 建立模型

Step4.

Evaluation 評估

Step5.

Devloyment 導入

Step6.

Interpretation & Insight 解讀與洞察

- 商業分析,行銷主管該關心的9個議題

1.我的目標對象是誰?

2.各品牌的消費對象有何不同?

3.消費者購買了什麼產品?

4.消費者對產品的滿意度如何?

5.消費者都接觸什麼媒體?

6.什麼通路的銷售最好?

7.什麼促銷活動最有效?

8.品牌是否已經老化?

9.新舊客人的比率有何變化?

- 預測分析,行銷主管關心9種個人行為

1.誰會點擊?(Who will click?)

--要觀察顧客在網路上的行為,有5個重要指標:

流量、

曝光量、

點擊率、

參與率與

轉換率。

2.誰會買?(Who will buy?)

--點擊的人很多,但誰才是最後購買產品的人?這就是轉換率。

企業花錢行銷,最後關心的也是這個。

3.誰會進入「沉睡」?(Who will lapse?)

4.誰會詐騙?(Who will lie?)

5.誰會掛掉?(Who will die?)

6.誰會是恐怖份子?(Who will commit crime?)

7.什麼時候買?(When will he/she buy?)

8.買什麼?(What will he/she buy?)

9.花了多少錢?(How much?)

* 商業分析演算法,就能解決80%工作難題,五種商業分析方法:

1.整體分析(Aggregate Analysis)。

可用來分析某個市場、品牌或產品的族群結構、產品結構或行銷組合等。

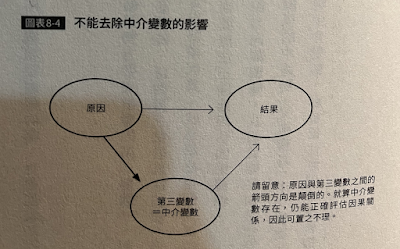

2.相關分析(Correlation Analysis)。

就是分析兩個或多個事件之關係,目的是希望找到其中一個事件對另一個事件的影響。

例如:「網路廣告量的多寡,是否與銷售有直接關係?」、

「上網時間的長短,是否會影響產品銷售的轉換率?」

3.規模分析(Sizing Estimation)

4.趨勢分析(Trend Analysis)是指一段時間內的總量發展趨勢,又可分為

縱斷面(Longitudinal Study)與

橫斷面分析(Cross-Sectional Study)。

例如:分析Facebook年齡結構的改變,發現10年來,年輕人的比率有減少的趨勢,則可判斷為品牌老化的徵兆。這是時間數列分析,也較縱斷面分析。又例如,第一季的廣告營收與去年同期相較,增加了20%,表示出現強勁的成長。同期比較的好處,是能克服季節性的影響,這種分析方法叫作橫斷面分析。

5.指數分析(Index Analysis)是以指數大小,判斷哪一個市場/品牌/產品較為突出。

以母體平均數作為分母,個別項目作為分子,會得到三個可能數字:大於、小於、等於100。

例如:以總體人口的各年齡級距,除A品牌對應的年齡層級距,乘以100,

就可以得到三個大於、小於或等於100的數字,而我們關心的是指數大於105及小於95的級距。

當指數小於95,代表A品牌的目標對象在該年齡層相對少;

大於105,則代表目標對象在該年齡層相對多。

* 預測分析演算法,創造另外80%的價值,七個演算法:

1. 迴歸分析(Regression Analysis):這是最常用到的統計演算法,主要是用已知的一件事

(自變數)來預測另一件事(因變數),稱為

簡單迴歸;也可以是已知的兩件事來預測另一件事,

稱為

複迴歸。

例如根據衛生紙及面紙的購買數量,預測家裡可能居住的人口數,

用來決定可以推薦個人產品或家庭常用品。

2. 邏輯迴歸(Logistic Regression):主要是處理「是」與「非」、「YES」與「NO」的問題。

例如預測一筆交易是否可能為盜刷?

一名顧客是否會逾期繳息?一個人是否可能得癌症?

工作中我們需要多做很多這一類0與1的決策,而邏輯迴歸提供了這樣的科學依據。

3.k-均值分群(k-mean Cluster):簡單說,就是將手中的資料根據某種方式分群,

同一群內的資料同值性高,不同群之間的差異大。

例如消費者生活型態的調查,同一區域的消費者,可以根據不同的活動、興趣及意見,

區分成不同的族群,而有所謂的「個體創業族」、「小確性逍遙族」等,

針對不同的族群可以採取不同的訴求及策略。

4.時間數列(Time Series):是按照時間收集及排列某個時間的數據,透過分析時間數列所反映出來

的發展過程、方向和趨勢,藉以預測下一個時點可能出現的事件。

例如收集及排列歷年的GNP、公司銷售數字,藉以預測下一階段的經濟成長及企業銷售。

5.決策樹(Decision Tree):顧名思義,這個方法將資料集中的變量由上而下分解,建立一個預測模型,

而這個模型長得像棵樹形圖,然後透過這樹形圖的流向來預測一個人的行為。

6.關聯法則(Association Rule):這是大數據預測的熱名應用,方法是尋找一個事件與另一個事件出現的

依賴性(例如爸爸下班買紙尿褲,就會順便把啤酒買回家),

如果有關係,就可以用一個事件的出現來預測另一個事件也可能會發生。

關聯法則的演算法包括

AIS,SETM及Apriori等,而Apriori是被廣泛應用的演算法,

它透過機器學習的原理,學習交易資料之間的關係,適合應用於大量資料的分析,

從而建構出一個預測模型。

-

關聯法則,可以應用於

購物籃分析決策(Market Basket Analysis)。

購物籃分析,目的是在探究貨架上產品是如何被消費者購買,產品與產品之間被拿取有什麼關係。

如果掌握到它們之間的關係,比如買A產品的顧客也會買B產品,就可以將這兩個產品擺在一起

(這是超市的決策);買A產品的顧客,就推薦他買B產品(這是電商的決策);

為了賣A產品,提供B產品優惠(這是促銷決策)。

- 到了2010年代,加拿大多倫多大學的Geoffrey Hinton教授,克服了人工神經網路反向傳播優化

(找出最小值)的問題,為機器學習重新換上了「

深度學習」的名字及應用了深度神經網路演算法。

深度神經網路演算法,是由輸入和輸出之間的許多「中間隱藏層」組成,演算法學習這些中間層的特徵。

* 大數據分析,從資料清理開始

第一個挑戰:沒有資料(No Data)

第二個挑戰:過時的資料(Out-of-date Data)

第三個挑戰:不完整的資料(Imcomplete Data)

第四個挑戰:遺失的資料(Missing Data)

第五個挑戰:稀少的資料(Sparse Data)

第六個挑戰:不精確的資料(Inaccurate Data):最常發生的狀況,就是用不同的衡量方法,

提供不一樣的資料。

- 大數據並非「數大就是美」,應該是「不怕少,怕不好」。

如果用在預測分析,例如透過機器學習建立大數據預測模型,資料是多多益善。

但是如果是大數據用在商業分析,2千筆的顧客或者銷售資料,

絕對比20萬筆沒有經過清理的資料來得有用。

例如:應用2千筆有效的會員資料,去做新會員推廣,轉換率絕對高於20萬筆,而且成本更低。

- 大數據要發揮價值,有兩個面向。

第一個,從資料分析中,看出問題,這個面向適合善於分析資料得大數據專家。

第二個,從實務中發現問題、大膽假設,再透過大數據找答案,這個面向具有實務經驗的專家,比較容易做到。

- 大數據預測科學就是predicting something for an individual case.

* 預測行銷,6個KPI檢視成效:

4個預測指標(Predictive Indicator),包括

Traffic(流量)、

Impression(曝光量)、

Engagement(參與數)、

Conversion(轉換數);以及兩個財務指標(Financial Indicator),

包括

CPA(Cost Per Action,每一互動成本)、

OPI(Operating Profit Index,毛利指數)。

1.

Traffic 流量:就是消費者可能接觸到你的品牌訊息的潛在最大數量;

但是事實上,不會這麼理想。不過,這個指標讓你知道,品牌的打擊面夠不夠廣,

是1萬人、10萬人,或者100萬人,也牽涉到行銷的成本,以及你對市場的企圖心。

2.

Impression曝光量:曝光在品牌訊息的不重複人數流量,就是Impression。

所以,如果你推播訊息給100萬個消費者或100萬封email給顧客,

實際上有看到這則訊息的人可能只有40萬人,這時你的Impression是40萬,

Impression Rate則是40%。

Impression可以說是最基本的績效指標,因為之後計算Engagement Rate及

Conversion Rate都是基於這個指標。

3.Engagement 參與數:有曝光在你推播訊息的消費者,或者收到你發送email的顧客,

不一定會看到你的訊息或打開你的email,所以這階段會關心到底有多少人參與了活動。

參與數的計算就包括了按讚、留言、分享、點「more」、按連結、滑照片、看影片、打開email。

4.Conversion 轉換數:轉換數,包含了要消費者或顧客的回應,比如下載檔案、安裝應用程式、

填寫問卷、註冊成為會員、達成交易等。這幾個轉換行為,可以一開始就設定為你的行銷目標,

例如這一波活動要吸收5萬個會員、達成1萬個人次的交易。

例如:

會員Conversion Rate = (會員Conversion / Impression) X 100%

成交Conversion Rate = (成交Conversion / Impression) X 100%

- Open Rate(開信率)、Engagement Rate(參與率)和Conversion Rate(轉換率)的共同分母都是Inpression(曝光量),這是因為便於在共同的基礎上做比較,解讀資料比較不會出現誤判。

5.CPA(Cost Per Action,每一互動成本):要知道一檔活動有沒有賺錢,首先要計算達成行銷目標,

也就是取得轉換數所需付出的代價,由此可以計算出CPA。

6.OPI(Operating Profit Index,毛利指數):OPI的計算方式,就是毛利除以總收入,乘上100;

如果是正的就是有利潤;如果是負的代表作越多,賠越多。

如果經優化,OPI還是負的,就代表不能再執行這類活動了,而且必須改變策略。

- 從以上的指標,一個個推演到這裡,你會發現要提高OPI,就必須要提高轉換率,要提高轉換率就必須要提高參與率,要提高參與率就必須要提高曝光率,每一環節都不能放過。

- Impression Rate = (Impression / Traffic) x 100%

- Open Rate = (Email的Open數/寄信數) x 100%

- Engagement Rate = (某事件的Engagement / Impression) x 100%

- Conversion Rate - (某事件的Conversion / Impressiom) x 100%

- CPA = Total Cost / Conversion (或Engagement)

- OPI = (淨收入 - 總變動成本) / 淨收入 x 100

V. 大數據X會員經營

- 企業經營的終極資產會是「品牌」加「會員」。

品牌代表了市場、訂價權,也代表了利潤,這個大家應該都知道。那為什麼是會員呢?有機個原因:

一是現在市場趨近飽和;二是開發新客人不容易;三是開發一個新客人的成本,幾乎是維持舊客人的5到10倍;四是業績每個月會歸零,但是會員會不斷累積;最後是手中有了會員,行銷的成本將大幅度降低。

- 在大數據時代,行銷大師Philip Kotler提出了

5A行為反應模式:

知名(Aware)、

訴求(Appeal)、

詢問(Ask)、

行動(Action),最後就是倡導

(Advocate)。

倡導就是請客人推薦客人,背後的思維就是會員經營。

- 三種潛在客人:準顧客、知道未買、完全不知

- 三種既有客人:首購客人、忠誠客人及冬眠客人。

- 首購客人是夠過行銷努力開發來的新客人;

而忠誠客人是因為對產品、服務滿意,而持續上門的客人。

公司的總體營收,就是由首購客人及忠誠客人所構成。

因此首購客人與忠誠客人的黃金比率,顯得非常重要。對於一個成熟的品牌而言,

這兩種客人的比率是3:7,也就是有3成的新客人持續為品牌注入活水,加上7成的死忠支持者。

- 兩手策略:一手握住手中的鳥,另一手森林中部斷抓來新的鳥,生意才會源源不絕。

* 先決定會員類型,再決定如何行銷

- 五級會員制度

- 傳統的行銷學講究

STP,先

區隔市場(Segmentation),然後訂定

目標客層(Target),最後進行

市場定位(Positioning)。然而在大數據時代,區隔市場的方法,有了巨大改變,不再靠地理區隔、人口統計或心理特徵當作變數,而是

以消費者行為來區分、預測顧客未來的行為。

- 大數據預測科學透過演算法,來預測每一位顧客的行為,但真正導入大數據預測科學演算法前,

仍可用簡單的行為變數,來分類預測顧客的行為。

行為分類的方法很多,歸納出三組變數,分別是RFM,4P,TCC。

1.

RFM:這是一般常用的方法,也就是根據客人的

回籠時間(Recency)、

客人的消費頻率(Frequency),

以及客人

對營收的貢獻(Monetary)來分類。

- 以「

回籠時間」為例,可以將既有的顧客分為「

第一次」來的客人、「

近一年」來的客人,

及「

超過一年以上」未回來的客人。

至於該如何區分客人回籠的時間,是「最近一年」,還是「最近三個月」?取決於該產品的消費者購改週期。

- 「

消費頻率」,則是按照客人的消費次數,加以排列。例如可以將最近一年來過的客人,按照1次到6次以上,算出每一種次數來的客人百分比。次數分配可以幫我們判斷,誰是「

忠誠客人」或「

重度使用者」。

- 「

營收貢獻」,則是顧客的購買金額。消費次數多的客人,不代表貢獻金額高。所以Monetary的分類,是要讓我們了解誰是重要的客戶。

根據80/20法則,20%的客人極有可能貢獻了80%的價值,把重要客人照顧好,基本盤就有了。

2.

4P就是按照

購買週期(Purchase Cycle)、

價格敏感度(Price Sensitive)、

促銷敏感度(Promotion Seneitive)及

獲利程度(Profitability)加以分類。

3.

TCC指的是

消費者的瀏覽及購買時間(Timing);

習慣在什麼通路瀏覽及購買(Channel),是否在線下瀏覽商品、線上購買,或者通通在線上或線下完成。

最後一個C,則是假設

顧客一生對公司貢獻的潛在價值(Customer lifetime value)。

- RFM-4P-TCC也適用於會員分類及行銷,實務上,我們可以用RFM將會員分級,再以4P+TCC來做會員行銷。

* 會員經營一部曲:以RFM為客群分級

(表2會員資料集按回籠時間(R)分類)

(表3會員資料集按消費頻率(F)及貢獻金額(M)分類)

(表4以R將會員分三級)

* 會員經營二部曲:設定分級權益

- 會員的權益可分成6大類,即

價格優惠型、

服務擴大型、

功能升級型、

內容加值型、

免費贈品型,

現金或點數回饋型。

- 實體品牌偏愛免費贈品型、服務擴大型;消費品電商偏愛價格優惠型;內容平台偏愛內容加值型;

工作類電商偏愛功能升級型;銀行、航空公司及零售業偏愛現金或點數回饋型。

* 會員經營三部曲:創造入會渴望

- 大數據會員行銷分成三個階段:入會前、入會時、入會後。

- 入會前要告訴潛在的消費者,為他所設計的「頂級」會員權益。

盡可能的把殺手級的服務或優惠攤在消費者眼前,同時詳細說明各種權益價值,

最終目的就是讓消費者成為會員。

- 入會時就是一旦消費者加入會員那一刻開始,就要給他絕佳的體驗。

*會員經營四部曲:會員行銷創造高業績

- 品牌與客戶互動的四種活動類型:

權益行銷、

預測行銷、

互動行銷、

全員行銷。

1. 權益行銷就是要用後台的大數據,監測會員的消費狀況,提醒會員可以不斷升級,享受更高的權益。

2. 預測行銷就是要用大數據的概念,建立模組,預測顧客的消費行為,適時推薦他需要的產品。

又可再分為「

一般購買行為預測」及「

產品購買週期預測」。

- 預測行銷透過

關聯法則學習(Association Rule Learning),Amazon及Walmart等零售商,可以知道消費者購買貨品之間的關係,再你買了A產品後推薦你買B產品,或者把B產品陳列在A產品旁邊,大大增加成交的機會,Amazon甚至有30%的營收來自預測行銷。

- 產品購買週期預測:只要掌握每一類產品的購買週期,在消費者的購買點之前,推播他必要的產品資訊、優惠方案等,就可以大大提高產品購買機會,為公司創造更高營收。

產品購買週期是結合消費者行為的預測方法,例如你可以將所有顧客劃分為一個購買週期、兩個購買週期、三個購買週期回來,以及超過三個購買週期未回來的客人,分別給予不同的行銷方案。

例如對於一個購買週期內回來1次以上的客人,表示對品牌及產品的忠誠度極支持度都比較高,可以進一步推薦關聯性的產品組合,進行交叉行銷(Cross-Sales),提高營收。對於超過一個購買週期尚未回來的顧客,可以發送提醒訊息(如問候),加強對顧客的關心,引起他的注意。對於超過兩個購買週期尚未回來的客人,表示這位客人準備進入「冬眠」的狀態,必須包裝更有吸引力的優惠方案,來吸引顧客回籠。

3.

互動行銷就是邀請消費者參加專屬的活動,可以分成一對一的線上活動,以及一對多的線下活動。

4.

全員行銷也就是只要是會員,不分等級都可以參加這類活動,包括購前提醒、購後致謝、

生日祝福、結婚紀念日慶祝、節慶關懷及新品訊息告知等六小類。

- 當掌握了會員資料之後,會發現還有很多事情可以做,例如:

1.

MGM:Member Get Member就是請現有的會員去邀請新會員加入,成功後雙方都可以給予優惠,

無論是傳統品牌或網路品牌都非常適合。

2.

異業合作:當手握龐大的會員資料,你賺的就不只是會員財了。可以透過異業合作,

一來為會員爭取權益,二來提高會員貢獻。

VI. 大數據X行銷迷思

- 360度品牌行銷

- 找出問題背後的問題(QBQ,Question Behind the Question)

-

當品牌形象出現問題的時候,採取什麼樣的大數據行銷都沒有用。

消費者對一個品牌失去好感時,無論透過什麼大數據分析、預測、推薦,都引不起消費者的興趣。

市場上不乏這類的品牌,逆勢而為,不斷促銷,打折打到骨折,都就不了這個品牌。

這時候最重要的事,就是品牌再造,而不是大數據或者任何行銷。

- 當我們在談品牌時,是假設產品特色及商業模式已經被消費者接受的,因為商業模式及產品必須走在品牌之前,畢竟「

沒有好產品,就沒有好品牌。」

靠行銷打出來的品牌,是不會持久的!反過來說,每間公司都會認為自己有一個好產品,

如果光有好產品,沒有好品牌行銷,也是埋沒在茫茫的產品之中。

- 大數據時代,今天的資訊與知識,明天可能就不適用了,所以面對改變唯一不變的就是

「知識與勇氣」。知識是每天吸收新知,不讓資訊與知識過期:

勇氣是擁抱新知識時勇敢踏出第一步,翻轉個人或經營的企業。