- 精確率(Precision,系統判斷正確的比例)

- 查全率(Recall,找出正確答案的比例,也稱為召回率)。

2026年4月3日 星期五

AI導入起手式

2026年4月1日 星期三

台灣AI大未來

2025年12月26日 星期五

AI思惟

Because AI(Artifical Intelligence),becomes AI.(Argmented Intelligence)

因為人工智慧,從而擴增智慧。

第一章 AI的憧憬與實現

▷推薦系統的概念主要分為兩種:這兩種方法也可以彼此搭配混用,但關鍵都是需要建立出所謂的預測模型。

- 內容過濾法Content filtering:此方法根據物品的各種特徵值,找出其它具有類似相似性質的相似物品並發展出預測模型。

- 協作過濾Collaborative filtering:主要是根據使用者的歷史行為,例如購買過的物品、瀏覽過的東西或是評價過的物品等,並結合其它用戶的相似行為來建立預測模型。

▷運算思惟Computational thinking:

- 「解構」(decomposition)的能力:運算思惟面對問題或挑戰時,會先將問題拆解成數個更小的問題,以降低複雜度。

- 「規律辨識」(pattern recognitionb):緊接著從拆解的小問題中,逐一檢視是否存在過往熟悉的規律或模式。

- 「抽象化」(abstraction)能力及設計「演算法」(algorithm)的能力:再來我們會試圖將問題抽象化,以方便找出解決問題的步驟。

▷例如,假設人臉辨識方法是根據設計好的步驟,採用人臉特徵來進行比對,那在碰到遮蔽部分五官的人臉或側臉時,這些特徵值便無法計算,從而無法比對資料庫中的數據。反觀人類在相同情況下,卻還是有能力辨識出熟悉的人臉。這就表示我們辨識人臉的方式,並不是只依靠臉孔上的五官位置、形狀等特徵來識別。事實上,人類顯然不是依靠運算思惟的解題步驟來辨識人臉。換言之,面對複雜、變化多端或模糊不清的問題,甚至連我們自己也都講不清時,就更不用說將問題抽象畫化成解題步驟了。所以這也說明了,儘管電腦計算能力很強大,但是在智慧方面卻一直無法跟人類相比。因為在運算思惟下,它只是人類設計解題步驟下的執行者。

▷既然我們無法將自身的解題方法完整地教給電腦,那期望它能像我們一樣,在沒有任何限制的條件下解決問題,無疑是緣木求魚。因此,換個角度思考,如果能讓電腦像人類一樣,透過學習解決問題,那麼電腦是不是就能自己自己產生解決問題的能力?答案很明顯,以前的電腦作不好也做不到。但今天的人工智慧最特別的地方,正是可以如此。只要提供有關的數據給人工智慧去學習,我們不再需要給出解題步驟,電腦自己就可以發展出一個解題模式。由於這個解題模型不再是依據給定的步驟來解題,因此它更能用於面對模糊不清、複雜且變化多端的問題。

►人工智慧思惟的第一個關鍵是-不用管如何解題、步驟是什麼;重要的是取得什麼數據、如何訓練。

第四章 AI的五種能力:分類力、預測力、視覺力、語言力、推理力

▷分類力:人工智慧更能從數據中找出人類所無法看到的關聯性,進而發展出過去人類所不具備的分類能力。

→非監督式學習:人工智慧根據數據透過訓練,將所有數據實際分類後並評估分類結果。最後再決定,要用哪一個特徵來當分類依據,使得各類別內的數據彼此間具有最多的相同特徵。

→分類力應用:市場區隔(Segmentation)、追加銷售、交叉銷售。

→電腦可以運用分類力,自動歸結出具相似性的銷售類型。

第七章 數據先行

▷對於企業而言,數據驅動創新的第一步-也就是怎麼知道需要什麼數據,究竟是從何開始呢?

- 數據的描述性(Descriptive)是指可以用數據來解釋已經發生的事,就像是個事後諸葛。

- 數據的預測性(Predictive)是指能夠利用數據,預測未來會發生什麼事以及該如何因應。

- 數據的指示性(Prescriptive),則是指透過運用數據,可以從整體觀指導運行步驟,獲得最有利的結果,並創造永續競爭優勢。

▷一種幫助數據驅動創新的方法是,讓企業內各種不同工作職能的人員問自己七個問題。

- 現在可能發生什麼事嗎?

- 有我需要知道的東西嗎?

- 有要給我的建議嗎?

- 有什麼該自動作的嗎?

- 有什麼是未來會發生嗎?

- 有什麼我該避免的嗎?

- 有什麼我該決定的嗎?

▶為了讓第一代的AI先發揮功效,我們不需要急於投入大量成本完善數據。反而是有什麼數據,就進行什麼訓練。有了第一步成果,再看需要補什麼數據並再次訓練。這是一個反覆的迴路,直到建立出我們最終想要的AI。

第九章 AI思惟的企業運用

▷金融、零售、流通與服務等相關產業,大部分已經採用虛擬助理、自然語言處理等,而機器學習等則正在發展中,這些類型產業投入人工智慧的目的,主要是以改善對外服務效率、客戶體驗以及推薦服務等為主。

▷ 企業數位轉型可以分從四個方向切入,分別是「賦能員工」、「改善顧客體驗」、「作業最佳化」以及「促成產品轉型」。

▷ 企業目前將人工智慧運用在改善顧客體驗上,較常見的有聊天機器人、推薦引擎以及智慧定向廣告等。

▶定向廣告指的是根據客戶資訊,分析出他們是不是潛在的購買顧客,以及應該向他們投放哪一個廣告才最有可能成交。相較於先前的無差別廣告模式,這不僅是一種更具成本效益的做法,同時顧客不會被沒有對應需求的產品廣告所打擾,也才能避免不佳的顧客體驗。而利用人工智慧建立客戶畫像、定位目標客戶群體,相比以前的做法,自然更可以做到廣告的精準投放。事實是投放越精準,客戶體驗自然會越佳。

▷在企業轉型的過程中,以顧客為核心,提升顧客體驗,絕對是成功的不二法則。其中,人工智慧在改善顧客體驗已經有明顯效益,而且應用範疇從行銷個人化、顧客互動,甚至到行銷活動最佳化、決策方案制定等,可說是無所不在,人工智慧已是企業達成精準行銷的重要角色。

▷以「流程化機器人(RPA,Robotic Process Automation)用在幫助作業AI化為例,流程機器人就像是老鞋匠的「小精靈」,能反覆執行機械化、有規則可循的作業。這個小精靈會根據作業內容,自動謄寫或從其他地方取得相關所需數據,並串聯其前後相關作業。

▷流程機器人讓企業員工不用一直糾結在沒營養的作業流程衝,而可以把時間花在更重要的任務上,並且流程機器人對企業來說,不僅有助所短作業時間,更可減少錯誤發生的機率。

▷作業AI化的轉型,勢必有助於企業反應更快、更正確、更有效,成本也會更低。更重要的是,作業AI化可以單點突破,讓有需要或有價值的地方先開始。

2025年9月13日 星期六

哈佛商業評論推薦必讀AI商業趨勢(下)

第八章 定價演算法趕走我的客人?請小心,別讓品牌受傷害

- 它缺乏必要的同理心,而需要這種同理心,才能預測和解決價格變化對顧客行為和心理造成的影響。

- 它缺乏長期觀點,而需要這種長期觀點,才能確保公司策略或總體經濟目的。

- 機器層次:成效指標應該關注實際運作的彈性。相較於人類員工,自動化系統會學習一項新工作需要多少時間?

- 系統層次:指標應該關注轉換成本。機器人或者自動化軟體需要多少時間來順利運作一項新流程?

- 團隊成效的指標最重要:自動化系統是否提升團隊的工作績效?團隊成員的表現是否優於過去?團隊是否能以更有創意的方式運用本身的技能?擁有自動化科技是否讓團隊做到以前做不到的事?

➤通用汽車「未來工廠」的願景,是要在不必開燈讓員工工作的情況下表有生產力與彈性。

但我們從率先推行自動化的公司那裡發現,就算公司能夠做到「關燈」自動化,多半仍不會這麼做。

2025年9月5日 星期五

哈佛商業評論推薦必讀AI商業趨勢(上)

哈佛商業評論推薦必讀AI商業趨勢

- 數據工作流(data pipeline):這是一個半自動化的流程,以系統化、可持續和可擴大規模的方式,收集、清理、整合和保護數據。

- 演算法:做出有關企業未來狀態或行動的預測。

- 實驗平台:在上面測試有關新演算法的各種假設,以確保這些演算法的建議可創造想要的效果。

- 基礎設備:這些系統會把這個流程建入軟體裡,並把它連結到內部和外部使用者。

- 一個策略:若要重新建構公司的營運模式,就必須在整合數據、分析和軟體的新基礎上,重新打造每個事業單位。這項深具挑戰性的耗時工作,需要有個焦點,以及一個由上而下交辦的一致任務,來協調和激發許多由上而下的行動。

- 一個明確的架構:一個以數據、分析和人工智慧為基礎的新方法,需要某種程度的集中化,以及高度的一致性。數據資產應該跨越各個應用軟體而整合起來,使它們的影響極大化。

- 掌握數據越多,越難被超越。你有足夠的訓練數據嗎?

- 令人望塵莫及的迴圈速度。你的回饋迴圈有多快?機器如果納入回饋數據,就能從結果中學習,並提高下一次預測的品質。

- 精準預判顧客需求。你的預測有多準?

- 特殊數據成為致勝關鍵:找出其他的數據來源,並固守這些來源。

- 尋找不同的服務對象:預測差異化。另一種可協助後進者變得更有競爭力的方法,就是重新定義什麼因素會讓預測變得「更好」,即使只是對某些顧客來說比較好。

- 尋求挑戰:剛接觸機器人手術的受訓人員通常沒什麼機會實作。偷學者解決這個問題的方法,是尋找機會在有限的監督下,挑戰本身能力極限的手術。他們知道有挑戰,才有學習的效果。

- 向第一線取經

- 重新設計角色

- 收集整理解決方案

- 向偷學者學習

- 潛在影響

- 相互關聯的活動:如果重新調校這些活動,可以解決系統性的問題,例如長期效率低下(像是冗長的貸款審核時間)、高變異性(迅速波動的消費者需求),以及經常錯失機會(難以提供產品給顧客)。

- 哪些顧客雖然被留下,但花費的成本比增加的終身價值高;

- 哪些高價值顧客雖然收到留住顧客的促銷優惠,但仍流失;

- 哪些高價值顧客沒有收到促銷優惠,而在促銷活動後離開。

2021年8月7日 星期六

2021年6月26日 星期六

人工智慧在台灣:產業轉型的契機與挑戰

人工智慧在台灣:產業轉型的契機與挑戰

第二章 機器學習是什麼?

例如能不能從醫生的X光判讀結果,學習到怎麼看新的X片?

能不能從一個人的刷卡及繳費行為,預測她若借十萬元會不會準時還款?

- 無論選擇哪一種類型的題目,以及使用哪一種模型,資料都是專案成敗的關鍵。

都會影響機器學習的準確度。

Part 2 人工智慧與產業發展

第五章 產業人工智慧化經驗談

- 零售業與金融業的共通日常決策問題之中,最常被關注的應該是發送廣告文宣。

- 在金融業中,人工智慧的應用可以大略分為五個面向:風險、行銷、服務、市場及作業流程。

風險面向就是對未來風險盡可能的精準預測,這裡提到的風險,

- 在行銷及服務面向,發送廣告文宣及個人化文宣設計就是一例。

- 再進一步,以文字或語音客服機器人來提供理財顧問,或保單規劃的服務,也都在可預測的未來之中,大幅延伸金融業的客戶服務範圍。

- 對於金融市場的掌握度,無論是大眾熟知的投資工具,如股票、基金、ETF、債券,或是與總體經濟息息相關的利率、匯率,無論希望做某種程度的預測,或設計交易策略,或是設計衍生商品,或做市場撮合(market making),機器學習與深度學習都是重要的關鍵技術。

Part 3 迎向未來的準備

- 最理想的做法是,在實驗的各種變化中蒐集資料,建立更好的機器學習模型;

2021年2月2日 星期二

AI必修課:日本情感研究權威的人工智慧秒懂攻略

AI必修課:日本情感研究權威的人工智慧秒懂攻略

第二章 人工智慧擅長與不擅長處理的事

- 聲音辨識系統會使用兩種技術以防止雜音造成錯誤判斷,一種是判斷人類說話時間區段的技術(聲音檢出),另一種則是去除混入雜音的技術(雜音去除)。

- 用比較專業的術語來講,聲音辨識是將輸入的訊號轉換成聲音特徵向量(將聲音的各種特徵數值化後的資料),再從一系列的聲音特徵向量推敲出對應的單字。

- 過去將聲音轉換成正確文字的過程可分為兩種模型,分別是「聲音模型」與「語音模型」。

- 聲音轉換成文字的過程是先分頭進行再匯合出結果。「聲音模型」就像是聲音的單字辭典,「語音模型」則是由上下文預測是那些單字組成。

- 隱馬可夫模型(HMM,Hidden Markov Model)

- 利用聲音模型或語言模型分別進行處理,想要正確預測出後面的單字仍有其極限。

- 語意網路(Semantic Network)在人工智慧發展初期便是著名的研究。

- 單字與其意義並不是任意存放在大腦記憶中,而是以聯想串聯起各單字所代表的概念,並將其意義相近的單字一起記憶下來。

- 潛在語意分析(LSA,latent semantic analysis)

第三章 人工智慧如何從資訊中學習?

- 機器學習大致上可以分為「監督式學習」、「非監督式學習」、「強化學習」等三種。

- 卷積式類神經網路(CNN,Convolutional Neural Network):CNN所使用的是誤差反向傳播法來調整權重,完成學習過程。

--卷積層(convolution layer)

--池化層(pooling layer)

--局部比對正規化層(LCN,local contract normalization)

--鏈結層(fullyconnected layer)

- 遞迴式類神經網路(RNN,Recurrent Neural Network):RNN是一種在聲音、語言、影片等序列式的資料處理上具有優勢的類神經網路。

- 波爾茲曼機

- AI三大家:深度學習的「類神經網路」、專家系統、遺傳演算法。

- 遺傳演算法(GA,Genetic Algorithm):GA常被應用在遊戲、股票交易、飛行路徑最佳化、飛機機翼大小最佳化等領域中。

2020年3月21日 星期六

圖解 AI 人工智慧大未來

- 透過形式主義的手法可以用數學重現人類的理論邏輯思考,

延伸閱讀<數學原理>懷海德(Alfred North Whitehead)與伯特蘭·羅素(Bertrand Russell)。

Chapter 2 自我學習的人工智慧

- 所謂監督式學習就是同時提供問題與答案讓人工智慧學習問題解決的方法。

- 強化學習讓人工智慧依照點數的增減來做自我評估,

如此,就會讓人工智慧朝著增加點數的方向學習。

Chapter 4 深度學習的誕生

- 類神經網路有別於傳統人工智慧技術,歷經長達60年的淬鍊,終於開始發揮它真正的價值,

也就是「深度學習」的誕生。

- 反向傳播法(Backpropagation)、卷積神經網路(Convolutional Neural Network)、

自動編碼器(Autoencoder)這三個技術是深度學習的研究基礎。

類神經網路的「調節計算」與「反向傳播」技術

- 克服單層感知器限制的是「反向傳播」技術的開發,透過與神經網路多層化的連結,

克服了原本「只能處理現應分割問題」的缺陷。

- 感知器在突觸間「加權計算」的研究上很受到矚目,但當要處理的規模變大時,

感知器就很難找出最適當的加權(也稱為權重),而用來解決此問題的方法也就是「反向傳播」技術。

- 首先確認類神經網路某一組輸入值對應的輸出值,與正確解答間的誤差為何。修正誤差時,

從輸出層反向對輸入層的加權計算做修正,因此稱為「反向傳播」。

- 傳遞錯誤訊息的人會給予較低的權重(降低點數),而對傳遞接近正確訊息的人給予

較高的權重(增加點數),一直修正到最初傳遞訊息的人(輸入層的突觸)為止。

- 反向傳播法技術並不是萬能的,其用來修正誤差的方式也只適用「監督式學習」,

而且無法有效處理4層以上的類神經網路。也就是說,其有效處理的部分只有3層的類神經網路。

實現多層次類神經網路的「卷積神經網路」

- 單層突觸無法解決的問題必須靠多層突觸解決,也就是說,藉由層次的增加,

讓處理資料的運用可以更「廣」也更「深」。卷積神經路時現類神經網路的多層化,

讓人工智慧得以做到影像辨識。

- 類神經網路的各層扮演著諸如「角度分析」、「曲線分析」、「直線分析」工作的角色,

最後再將各種特徵做綜合比較並重現類似人類辨識的能力。

突破多層次限制的「自動編碼」技術

- 為處理4層以上卷積神經網路無法有效運作問題,解決的方法就是利用「自動編碼器」技術,

就由「編碼」(壓縮)與「解碼」(解壓縮)的方式帶來了出奇的效果。

- 「自動編碼器」技術的另一個重點是資料編碼。編碼就是把整體的符號數變少,

也就是做資料的「壓縮」。事實上,「做壓縮」就等於是「辨識特徵」,不但可以刪除不必要的資料,

也可以減少傳遞錯誤資料的可能性。

深度學習的誕生與特徵取出能力

- 「深度學習」也可以說是把人工智慧用在,篩選、擷取和分析「卷積神經網路中」

每一層資料的特徵。這項革命性技術讓原本只能由人力輸入的參數設定(特徵擷取),

改為透過機器學習來處理。

藉由深層強化學習提升「辨識力」

- 深度學習與強化學習結合就變成「深度強化學習」。所謂的強化學習,就是要讓人工智慧

反覆錯誤中學習並給予過給予獎勵來接近市場目標的學習方法,

主要運用在遊戲或路徑搜尋等在特定環境行動的人工智慧。

- 而「深層強化學習」的最大特點就是深度學習的特徵擷取。

擅長影像辨識的「卷積神經網路」

- 在多層次類神經網路中,最具代表性的就是「卷積神經網路」(CNN,Convolutional Neural Network),特別適用於影像辨識CNN的特點就是擅長強調特徵處理。採用「卷積」的處理方式,會把影像的特徵(如形狀、顏色、樣式等)先做分類,然後再強調特徵的部分,之後再藉由特徵來比較判斷

「此特徵是屬於什麼影像」。換句話說,卷積處理可以除去不必要的資料。

- 卷積神經網路除了「卷積處理」外,還有另一個「池化」(Pooling)技術,也就是先確認影像特徵

(如形狀、顏色、樣式等)的組合方式,然後再統整為一個資料來處理。在把影像切割成細小像素再組合的部分與卷積的方式一樣,但在影像處理上是不同的。「池化」是把影像的解析度降低處理,而「卷積」只是把特徵的為小部分保留組合起來,並不會改變影像的解析度。

機器翻譯的革命技術「循環神經網路」

- 「循環神經網路」(RNN:Recurrent Neural Network)擅長處理自然語言,

「循環」就像是雞生蛋、蛋生雞的關係,結果就是原因的一種循環。這和程式語言的「遞迴」概念相同。人工智慧在理解句子時,最大的問題就是單字的意思會隨句子變化。

譬如把「我養貓」分成「我」、「養」、「貓」,每個字有自己的意思,

而字與字之間的組合也有其關係性,全部合起來就構成一整句的意思。這裡就出現了所謂的循環性:

如果不知道單個字的意思就不知道彼此的關聯,而不知道彼此的關聯就不知道單個字的正確意思。

將單字與文章的意思「向量化」

- 藉由「循環神經網路」讓人工智慧可以翻譯出更流暢的自然語言,為了更進一步提升其翻譯能力,

開始了將單字與句子含意「向量化」的研究。

人工智慧藉由可自由使用的資源而持續進化

- 深度學習帶給人工智慧研究的衝擊因研究成果採用開放原始碼形式而更加快速。

譬如Google所提供的TensorFlow,透過Open Source(開放原始碼)的軟體函式庫,無論是誰都可以自由使用或是將其商業化。其他像是日本新創公司Preferred Networks提供Chainer、加州大學柏克萊分校釋出的Caffe等軟體框架(Framework)或函示庫,也紛紛採用開放原始碼方式。

2019年12月29日 星期日

創智慧-理解人腦運作,打造智慧機器

Jeff Hawkins & Sandra Blakeslee

第二章 神經網路模式

- 「自體聯結記憶」(auto-associative memories)模式,是建構在簡單的神經元上,它們互相連結,當刺激超越特定閾值時,就會激發,只不過它們相互連結的方式不同,還多加了很多回饋。它不像後向傳遞網路,只把訊息往前送,這個自體聯結記憶模式將每個神經元的輸出送回原來的輸入,有點像跟你自己打電話。這個回饋迴路引出了一些有趣的特質,當某個行為型態被送進人工神經元時,它們會形成對這個型態的記憶,這個自體聯結神經網路會把這些型態與它們本身連結起來,所以稱之為自體聯結記憶模式。

- 這個自體聯結記憶模式不像其他的神經網路模式,它可以儲存一序列的型態,或是具有順序的型態。這個特質是因為它在回饋中加了延宕反應時間,因為有這個延宕的差異,你就能將一序列的型態,如一段旋律,呈現給自體聯結記憶模式的神經元,它便可以記住這個序列。

- 這個問題不在於我們有沒有足夠的資料或是正確的資料,我們需要的是換個角度來看。有了合適的架構,那些細節才有意義,也才能被歸納到正確的位置。

第三章 人類的大腦

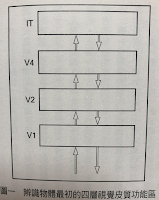

- 最低的功能區域就是初始感覺區(primary sensory area),這是外界感覺訊息到達皮質的第一站。這裡所做的處理是針對訊息最原始、最基本的部分。例如,視覺訊息經由初始視覺區的V1進入皮質,V1注意的是低層次的視覺特質,如微小的邊緣部分、縮小比例的動作部分、雙眼視差(binocular disparity)、最基本的顏色與明暗對比的訊息。V1再把訊息送到V2、V4和IT,以及其它一大堆地方,而這每一個區域都能特化的或抽象的來處理訊息。如在V4區的細胞處理中等複雜的物體,像是分辨不同顏色(紅或藍)的星形。另一個區域叫IT,它專攻於處理物體的動作。視覺皮質再往上的等級就是你表徵視覺記憶的功能區,所以你會認得出臉、動物、工具、身體部位等等。

- 所有的神經元都有共同的地方,除了圓圓的細胞體外,還有像細鐵絲一樣的分枝叫軸突(axons)和樹突(dendrites)。當一個神經元的軸突接觸到另一個神經元的樹突時,形成一個小的連結點叫突觸(synapse),突觸就是一個細胞的神經衝動影響另一個細胞行為的地方。一個神經的訊號到達突觸時,可以使下一個細胞比較容易發射或比較不容易發射,因此突觸可以是促進的或是抑制的。突觸的強度會因兩端細胞的行為而改變,最簡單的突觸改變型態是當兩個神經元幾乎同時活化(發射)時,這兩個神經元中間連結的強度就增加,這叫海伯學習定律(Hebbian learning)。

第四章 記憶

- 皮質用的是先前儲存的記憶來解決問題以及產生行為,而非計算出問題的答案。電腦也有記憶,它儲存在硬碟及記憶晶體中。然而,新皮質的記憶跟電腦記憶至少有四個基本的差異:

1.新皮質儲存的是序列的型態

2.新皮質是自體聯結的回憶出型態

3.新皮質是以不變的結構形式儲存型態(不變表徵invariant representations)

4.新皮質以階層性儲存型態

第五章 智慧的新架構

- 人類的皮質很大,可以儲存很多記憶,它不停地預測你即將所見、所聽與所感,只是大多為潛意識的,你並不自覺。這些預測就是我們的思想,當這些預測與感覺輸入結合起來時,它就是我們的知覺,我把這個看法稱作智慧的記憶-預測架構(the memory-prediction framework)。

- 訊息可以透過回饋系統從階層高處流往階層低處。有很多的神經軸突束從高階的IT流往低階的V4、V2和V1,此外,在視覺皮質區,回饋的神經連結網路跟向前的輸送連結一樣緊密,甚至更密。

- 但是當你開始瞭解到大腦的基本核心功能是做預測時,你就需要將回饋加到你的模式中,大腦必須能夠將訊息送回到一開始接受輸入的區域,因為做預測需要加入比較現在正在發生什麼以及你預期將要發生什麼;現在正在發生的是向上送的輸入,你預期將要發生的是向下流的預測。

- 初始聽覺區(A1區域)所能接受的型態差異是非常大的。一個字可以有不同的口音、不同的聲調、不同的速度,但是到更高階的皮質時,這些低階的特徵都無關緊要了,一個字就是一個字,不管在聲學上的差異有多大。

- 往下送的訊息填補了目前輸入的訊息,做出預測下一步會經驗到什麼。

- 高階的皮質是在掌管全貌,而低階的區域則是活躍的在處理快速變化的小細節。

- 假如皮質能開口,它會說:「我經驗到很多不同型態,有的時候我無法預測下一個出現的型態,但是這幾組型態絕對是彼此有關係的,它們總是一起出現,我可以很有信心的就在它們之間以逸代勞。只要我看到它們其中之一,我就可以推論它們一整組都存在。我往上呈報給上一級長官之道的不是個別型態的名字,而是這一整組的番號。

- 所以大腦可說是儲存「序列的序列」,皮質的每一區學習序列,發展出我所謂的「名字」或「序名」來稱呼它所學到的序列,然後把這個名字傳給皮質階層中它的上一級。

- 所以現在你可以正式開始工作了。你要在所有的輸入型態中找序列。分類和找序列這兩者是創造不變表徵的兩個必要條件,皮質的每一個區域都在做這樣的事。

- 當一個輸入是模擬兩可的,如上面既紅又橘的色紙,這時形成序列的功夫就回本了。即使你不確定它是偏紅還是偏橘,你仍必須為它挑選個桶子。假如你知道這一系列輸入最可能的序列是什麼的話,你就可以利用這個知識去分類這模稜兩可的輸入。假如你認為它們是RRGPOG序列的一員,因為你前面已經看到兩個紅色的、一個綠色的、一個紫色的,你可能會認為下一張色紙的顏色應該是橘色的,然而當收到下一張卻不是橘色的-即使它是介紅、橘之間,而且可能更偏向紅色-但是因為你熟悉並期待RRGPOG序列的關係,所以你會把它歸到橘色的桶子裡,你利用已知序列的情境資訊來解決模擬兩可。

- 請注意,序列的記憶使你不但能分辨目前輸入的模擬兩可性,同時也預測了接下來的輸入應該是什麼。

- 在皮質區,由下而上的分類及由上而下的序列是不停的在交互作用,一生都不停的在改變,這就是學習的本質。事實上,皮質的所有區域都很有彈性,可以被經驗所改變,形成新的分類及新的序列正是你記憶這個世界的方式。

- 在人工智慧及機械視覺的研究領域裡,很多人都聽過形態分類(pattern classification)這個名詞,讓我們來看一下這個歷程跟在皮質中有什麼不同。為了要使機器能辨識物體,研究者通常是創造一個樣版,例如,一個咖啡杯的樣子或某種杯子的原型,然後教導電腦將輸入與樣板配合。假如配合得很接近,電腦便認為它找到了一個咖啡杯;但是我們的大腦並沒有樣版,而且每一個皮質區所接受的輸入也不像圖片,你不會記得你視網膜所看到東西得快照,或是你的耳蝸會或皮膚形態的快照,皮質的階層性使得物體的記憶分布在各階層間,它們並不是單獨存在某一個點上。同時,因為每一個皮質都形成不變的記憶,一個典型皮質所學習到的是不變表徵的序列,它本身就是不變記憶的序列,在大腦裡你找不到咖啡杯或任何物體的相片存檔。

- 我的目的是讓你看到皮質區內的細胞如何學習和回憶形態序列,這正是形成不變表徵和做預測最重要的元素。

- 第六層細胞代表著皮質區域認為要發生的事,是特定的預測,假如一個第六層細胞可以說話,它可能會說:「我是代表某種事物的神經柱中的一份子。以我個人的情形,我的神經柱代表了音樂D-A音程,其它神經住代表其它的東西。我只能替我的皮質區域說話,當我變得活化時,就表示我的神經柱認為音程D-A正在發生或正要發生,我可能會因為從耳朵近來從下而上的輸入而活化,結果引發在我神經柱中的第四層細胞活化了整個神經柱;或者,我的活化也可能代表我們辨認出旋律,所以預測到下一個音程。不管哪一個方式,我的工作是告訴低層皮質區域我們認為正要發生的事,我代表了我們對世界的解釋,不管這個解釋是真的或只是我的想像。

- 在你清醒的每一個時刻,大腦皮質的每一區域,都在比較由上到下驅動的預期神經柱以及由下到上驅動的觀察神經柱,這兩組比對結果香蕉的地方就是我們所知覺到的。

- 資深神經網路科學家葛羅斯堡(Stephen Grossberg)把這叫做「摺疊」的回饋(folded feedback),我則比較喜歡「想像」(imaging)。

第七章 意識和創造力

- 智慧可以由三個時期來看,每一個都用到記憶和預測。

第一個時期是物種用DNA作為記憶媒體。個體無法在有生之年學習和適應,只能將以DNA為基礎的世界記憶透過基因傳給子孫。

第二個時期是當自然界發明了能夠快速形成記憶並可以被修改的神經系統。至此,個體可以學習世界結構中中意的事物,在有生之年根據外在改變,修正行為。但是個體除了透過直接觀察的方式以外,仍然無法將知識傳給後代。新皮質的產生和擴張是在這個時期,但是並沒有闡明解釋它。

第三也是最後一個時期是人類所獨有,它開始於語言的發明和新皮質的擴大。人類在有生之年可以學習很多外在世界結構,也可以很有效的利用語言將這些知識傳給其他人。我花了一生中很多的時間來搜尋大腦的結構,以及這個結構如何產生思想和智慧;透過這本書,我將我所學到的傳遞給你,而這些科學家又是從在他們前面的科學家身上習得他們一生累積的知識,就這樣世代相習而相襲,我能夠吸收關於前人的想法與觀察,並加入自己的看法,沒有知識的傳承,人類的文明不可能如此進步。

- 創造力並非一種非凡的特質,並非需要很高的智慧和天份。創造力可以簡單得的定義為用類比的方式去預測,這是皮質上各區域都在做的事,這也是你只要醒者就不停在做的事。

創造力的發生乃是沿著一條連續得巨軸:從日常生活簡單地預測知覺(比如說聽到同一首歌,但調子不同),到困難的天才型作為(用前所未有的方式創作一首交響曲);前者發生在皮質的感覺區,後者則在皮質的最高階。在最基本的層次,日常生活裡的知覺預測行為其實跟蓋世、罕見的天才發現是很相似的,只是每天的預測行為太普遍了,以致我們忽略了它。

- 它用的是類比過去的經驗去預測未來。我們一般雖不認為這種行為是有創造力的行為,但是仔細想一想,它的確是。

- 創造力是透過類比做預測,因為它四處可見我們反而不容易注意到它的存在。

- 不過,當我們的記憶-預測系統在一個抽象的高層次運作時,當它用不尋常的類比做出一個不尋常的預測時,我們是真的認為我們是有創意的。

- 創造力是可以訓練的嗎?是的,絕對可以。我發現在解決問題時有很多能培養找到有用類比的方法。第一,你必須誠實的假設這個問題是有解的,很多人太容易就放棄了,

你必須有信心,解決之道正在等著你去發現。你一定要鍥而不捨的持續想這些問題。

第二,你必須讓你的心智漫遊晃蕩,你必須給大腦時間和空間去發現答案。找到一個問題的答案精確的說其實就是發現一個儲存在你皮質當中,可堪與目前待解的問題相比的

形態。假如你陷在問題中出不來,記憶-預測模式建議你應該找不同的方式來看這個問題,以增加從你過去經驗中看出類比的可能。假如你只是坐著在那裡猛盯著問題看,你是走不遠的;請將這些問題的部分拿來重新安排,用幾個不同的方式來呈現它。

- 假如你陷在問題中,沒有進展,最好先離開一陣子,先去做別的事情,然後再從頭開始,換一個新的方式去解釋這個問題。假如你這樣做個許多次,'遲早你會發現重點,豁然開朗。它可能要花上幾天或幾星期,但終有一天你會突然開竅。你的目標是尋找過去類似的情境經驗使你可以得出類比來,但是想要成功,你必須常常去思考這個問題,同時做些別事情,使皮質有機會找出一個類似的記憶。

- 直到今天,我還聽到有人說電腦應該適應使用者,這其實不見得總是對的,我們的大腦喜歡一致性和可預測的系統,但千萬別忘了我們也喜歡學習新的技術。

傑夫•霍金斯談大腦科學將如何改變電腦| TED Talk

2017年8月6日 星期日

從人到人工智慧,破解AI革命的68個核心概念

2017/05/06

- 人工智慧三巨頭-類神經網路(Neural Network,NN)、專家系統(Expert System)、

遺傳演算法(Genetic Algorithm,GA)。

- 深度學習(Deep Learning)是運用類神經網路的技術之一。

深度學習是「只要將資料輸入類神經網路,它就能自行抽出特徵」的人工智慧。

- 卷積神經網路(Convolutional Neural Network)。

它的特性是,將輸入的資料切成各種大小的片段,抽出特徵,使其成為多層次

架構的中間層。例如輸入車子的圖像,它會抽出細部的模式,乃至大的構造和整體輪廓等。

- 機器學習(Machine Learning)分為監督式學習(Supervised Learning)和非監督式學習(Unsupervised Learning)。

- 強化學習(Reingorment Learning)-指引學習方向是稱為獎勵的概念,獎勵是對結果的估計值。

如何定義獎勵,決定了學習的方向。

- 蒙地卡羅搜尋樹(Monte Carlo tree search,MCTS)

- 深度Q網路(Deep Q-network,DQN)是將深度學習與強化學習之一的Q學習組合而成。

-最陡下降法(Steepest Descent Method)-是利用類神經網路的誤差倒傳遞,運用於學習的收斂演算法。

2017年7月19日 星期三

2016年12月6日 星期二

了解人工智慧的第一本書

松尾豐

2016/08/11

- Google收購了由多倫多大學教授Geoffrey E. Hinton成立的新創企業DNNResearch

以及英國的DeepMind Technologies。

第一章 何謂人工智慧:專家與社會大眾的認知落差

<與機器競賽>

<皇帝新腦:有關電腦、人腦及物理定律>

(The Emperor's New Mind:Concerning Computer,Minds,and the Laws of Physics)

<人工智慧:現代與方法> (Artificial Intelligence:A Modern Approach)

<創智慧:理解人腦運作,打造智慧機器> (On Intelligence)

第一級:把純粹的控制程式稱為「人工智慧」

第二級:典型的人工智慧

第三級:加入機器學習的人工智慧

第四級:加入深入學習的人工智慧

- 人工智慧研究的分類

第二章 「推論」與「探索」的時代:第一次人工智慧熱潮

- 探索樹、河內塔、機器人的行動規劃

第三章 只要輸入「知識」就會變聰明:第二次人工智慧熱潮

- 專家系統、表達知識、本體論、華生

第四章 「機器學習」悄悄地在擴大地盤:第三次人工智慧熱潮

- 統計自然語言處理(statistical natural language processing)

- 所謂的「學習」就是「分類」,分類方式:

最鄰近法(nearest neighnor)、簡單貝式分類法(Naive Bayes)、決策樹(Decision Tree)、

支援向量機(Support Vector Machine)、神經網路(Neural Network)

- 透過神經網路辨識手寫文字

- 誤差倒傳遞(EBP,error back propagation):一再重複同樣的流程,以慢慢提升辨識的精準度。

- 學習固然花時間,但預測只要一瞬間

第五章 打破寂靜的「深度學習」:第三次人工智慧熱潮

- 深度學習(deep learning):電腦可以根據資料,自行創造出特徵量。

- 深度學習與以往的機器學習大不相同的地方有二:

(1)一層層逐漸學習下去

(2)使用了自動編碼器(auto encoder)當成「資料壓縮器」。

- 把有相關性的東西湊成一組,再用它來抽取高層次的特徵量。

- 自動編碼器利用本來應該由老師提供的、相當於正確答案的部分,並輸入原本的資料,藉以預測所輸入的資料本身。而且也會形成各種特徵量。這形同是利用有師學習的方式進行無師學習。

- 增加深度輸入

- 只要預先掌握這個世界上「相關事象」的相關狀況,在學習處理現實問題時,速度就會變快。因為,既然有相關,那麼在背景中,應該隱藏著某種現實的結構在其中才是。

- 深度學習的出現,至少在圖片與聲音的領域中,帶來了讓電腦自動得知

「應該如何根據資料做特徵表達」的可能性。

終章 逐漸轉變的世界:對產業與社會的影響以及戰略

- 十至二十年之後可能消失與留下的職業

- 人才充沛是逆轉王牌:

計算機協會(ACM)、電機電子工程師學會(IEEE)、

國際人工智慧協會(AAAI)、日本人工智慧學會(JSAI)

2016年9月27日 星期二

人工智慧的未來

2015/08/01

-隱藏式馬可夫層級模型(hierarchical hidden Markov models,HHMMs):

它包括一個層級模型,每個更高層級都比其下較低層級的概念更加抽象。

以語音辨識為例,層級包含最底層的聲頻等基本模式,

然後是音位,再來是詞語和詞組(經常被辨識成詞語)。

有些語音辨識系統能理解自然語言命令的含意,

所以像名詞和動詞詞組的結構這些較高層級也包含在內。

每個模式辨識模組能辨識來自較低概念層級模式之線性序列。

每個輸入都有權重、大小和大小可變性等參數。

-隱藏式馬可夫模型

-演化(遺傳)演算法(evolution (genetic) algorithm)